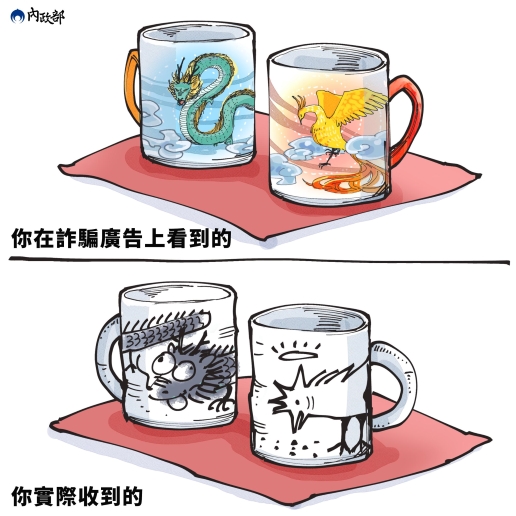

近期Line流傳一則提醒訊息,警告民眾接到陌生電話時不要先出聲,若對方不說話應直接掛掉,因為AI技術可能會蒐集聲音用於詐騙。此訊息通常伴隨新聞影片或報導連結,廣泛流傳。 社群平台、通訊軟體流傳訊息擷圖(圖 / 翻攝自台灣事實查核中心網站)

社群平台、通訊軟體流傳訊息擷圖(圖 / 翻攝自台灣事實查核中心網站)

陌生電話能利用AI複製聲音嗎?應避免先說話嗎?

成功大學統計學系教授許志仲表示,AI技術確實進步快速,約5到10秒內即可模擬出人聲。然而,電話音質差、容易失真,且若僅有1至2句簡短問候語,難以生成高品質的AI聲音。因此,民眾應保持警覺,但毋須過度擔憂到接電話時不出聲。

許志仲教授指出,目前AI聲音詐騙案例大多針對名人,因為公開影像多,容易被製作成詐騙工具。至於一般民眾,雖有模擬家人聲音進行詐騙的案例,但相對少見。

資安專家、Whoscall資深產品策略協理劉彥伯表示,該傳言雖立意良善,但過於誇大。現今AI技術確實可在5到10秒內模擬真實人聲,但須是連續且有情緒起伏的談話。單一簡短的「喂」、「你好」不至於立即讓AI生成聲音,但遇到可疑電話仍應直接掛斷,不要進一步對話。

資安院專家亦強調,觀察國際AI技術趨勢,1年前即能以短短5到10秒聲音製作擬聲,現今技術更為成熟。然而,由於電話音質差,且問候語通常簡短,即使生成AI聲音,質量也難以達到可騙人的程度。因此,民眾應保持警惕但毋須過度防備。

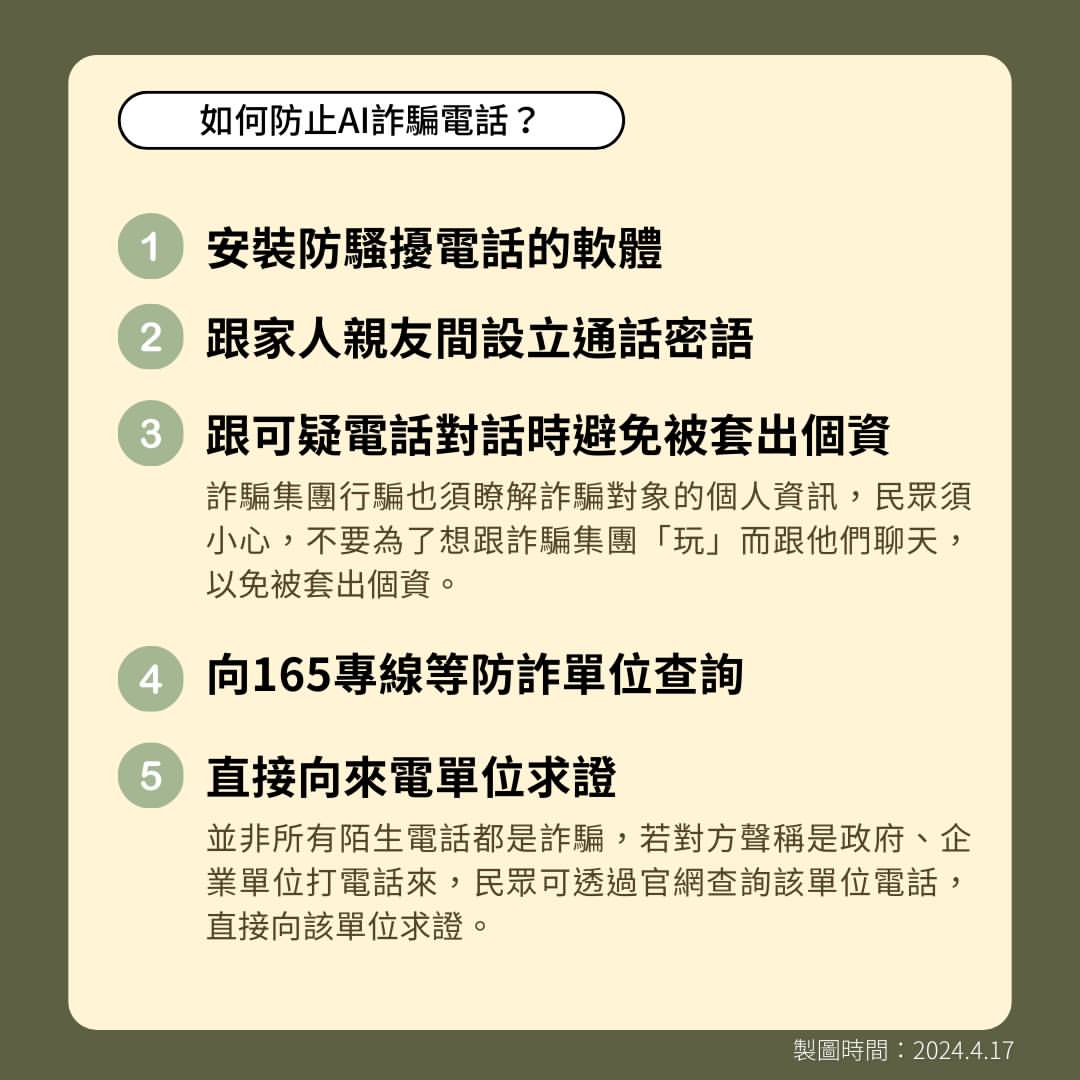

防止AI詐騙的建議

劉彥伯建議,民眾可安裝防騷擾軟體以降低風險,並與家人設立密語。此外,詐騙集團需掌握個人背景資料進行詐騙,民眾應避免與可疑來電閒聊,防止洩露個資。

劉彥伯提醒,雖應對陌生電話提高警覺,但並非所有來電都是詐騙。接到聲稱來自政府或企業的來電,應先求證號碼或向165反詐騙專線查詢。 如何防止AI詐騙電話?(圖 / 翻攝自台灣事實查核中心網站)

如何防止AI詐騙電話?(圖 / 翻攝自台灣事實查核中心網站)

AI詐騙技術的威脅

外媒報導指出,AI風險評估公司Blackbird.AI創辦人哈利德表示,詐騙集團已利用AI技術複製人聲,進行語音詐騙,竊取銀行資料或要求轉帳。AI模擬聲音與真人極為相似,尤其針對公眾人物更具威脅,詐騙者可利用公開發言片段生成AI聲音,甚至只需3秒即可完成。

目前尚無有效辨識AI聲音的方法,因此接到要求緊急匯款的親友來電時,務必再次確認。此外,民眾應減少在網路公開個資,避免成為詐騙目標。

這些傳言雖有部分根據,但目前仍不至於需要過度恐慌,保持警覺、合理應對是最佳策略。